En el vertiginoso avance de la computación moderna, nos hemos acostumbrado a que los modelos de lenguaje respondan con una seguridad pasmosa, incluso cuando carecen de fundamentos reales.

Esta tendencia a la fabulación, conocida técnicamente como alucinación, representa el mayor obstáculo para la integración de la tecnología en sectores críticos.

Sin embargo, un equipo de investigadores del Laboratorio de Ciencias de la Computación e Inteligencia Artificial del MIT (CSAIL) parece haber dado con una solución elegante: enseñar a las máquinas el valor de la honestidad mediante un ajuste en sus algoritmos de aprendizaje.

Tabla de Contenidos

- 1 El origen del sesgo y la incertidumbre en modelos de lenguaje

- 2 El mecanismo de la alucinación desde DeepDream hasta ChatGPT

- 3 RLCR: Calibrando la confianza mediante el rigor matemático

- 4 Hacia una integración segura de la IA en entornos de alto riesgo

- 5 El camino hacia una transparencia algorítmica sin precedentes

- 6 About Post Author

El origen del sesgo y la incertidumbre en modelos de lenguaje

Para comprender cómo hemos llegado hasta aquí, debemos observar los cimientos del entrenamiento convencional. Históricamente, los sistemas de inteligencia artificial han sido diseñados bajo un esquema de recompensas binario.

Si el modelo acierta, recibe un estímulo positivo; si falla, uno negativo. A simple vista, este método parece lógico, pero esconde un defecto estructural peligroso: no distingue entre una respuesta correcta basada en el razonamiento y una obtenida por puro azar.

Esta arquitectura de aprendizaje fomenta una autoconfianza desmedida. Al no existir una penalización por dudar, el sistema interpreta que “adivinar” es una estrategia válida para maximizar sus beneficios.

Como resultado, la incertidumbre en modelos de lenguaje se oculta tras una fachada de veracidad absoluta, lo que puede derivar en consecuencias desastrosas cuando se aplican en entornos médicos, legales o financieros.

El mecanismo de la alucinación desde DeepDream hasta ChatGPT

La génesis de este comportamiento se remonta a los primeros experimentos visuales de Google, como DeepDream. En aquellos modelos, el proceso era iterativo: la máquina buscaba patrones abstractos en el ruido y, al creer ver algo —por ejemplo, un ojo—, editaba la imagen para que se pareciera más a ese concepto.

Este bucle de retroalimentación creaba imágenes surrealistas donde la IA se convencía progresivamente de su propia interpretación errónea. Los modelos de lenguaje actuales operan bajo una lógica similar, aunque menos visual. Comienzan con inferencias simples y, sobre esa base, extrapolan conclusiones complejas.

Si la premisa inicial es falsa, pero el modelo no tiene herramientas para evaluar su propio desconocimiento, construirá un rascacielos de información sobre cimientos de arena. La incertidumbre en modelos de lenguaje no es solo un fallo de datos, es un fallo de autoevaluación.

RLCR: Calibrando la confianza mediante el rigor matemático

La innovación propuesta por el CSAIL se denomina RLCR (Reinforcement Learning with Calibration Rewards). Esta técnica introduce una métrica clásica de la estadística conocida como la Puntuación de Brier (Brier Score).

A diferencia del entrenamiento estándar, el RLCR no solo evalúa si la respuesta es correcta, sino que cuantifica la brecha entre la confianza declarada por el modelo y su rendimiento real en la tarea.

Bajo este nuevo paradigma, el sistema se rige por reglas mucho más estrictas:

-

Una respuesta incorrecta con alta confianza recibe una penalización severa.

-

Una respuesta correcta lograda con baja confianza (una “suerte” estadística) también es penalizada.

-

El sistema solo es recompensado plenamente cuando está en lo cierto y afirma estar seguro, o cuando admite su duda ante información ambigua.

Este enfoque transforma la incertidumbre en modelos de lenguaje de un defecto en una virtud. Al integrar la calibración de recompensas, logramos que la IA desarrolle una suerte de autoconciencia técnica, permitiéndole admitir un “no lo sé” antes de arriesgarse a difundir desinformación.

Hacia una integración segura de la IA en entornos de alto riesgo

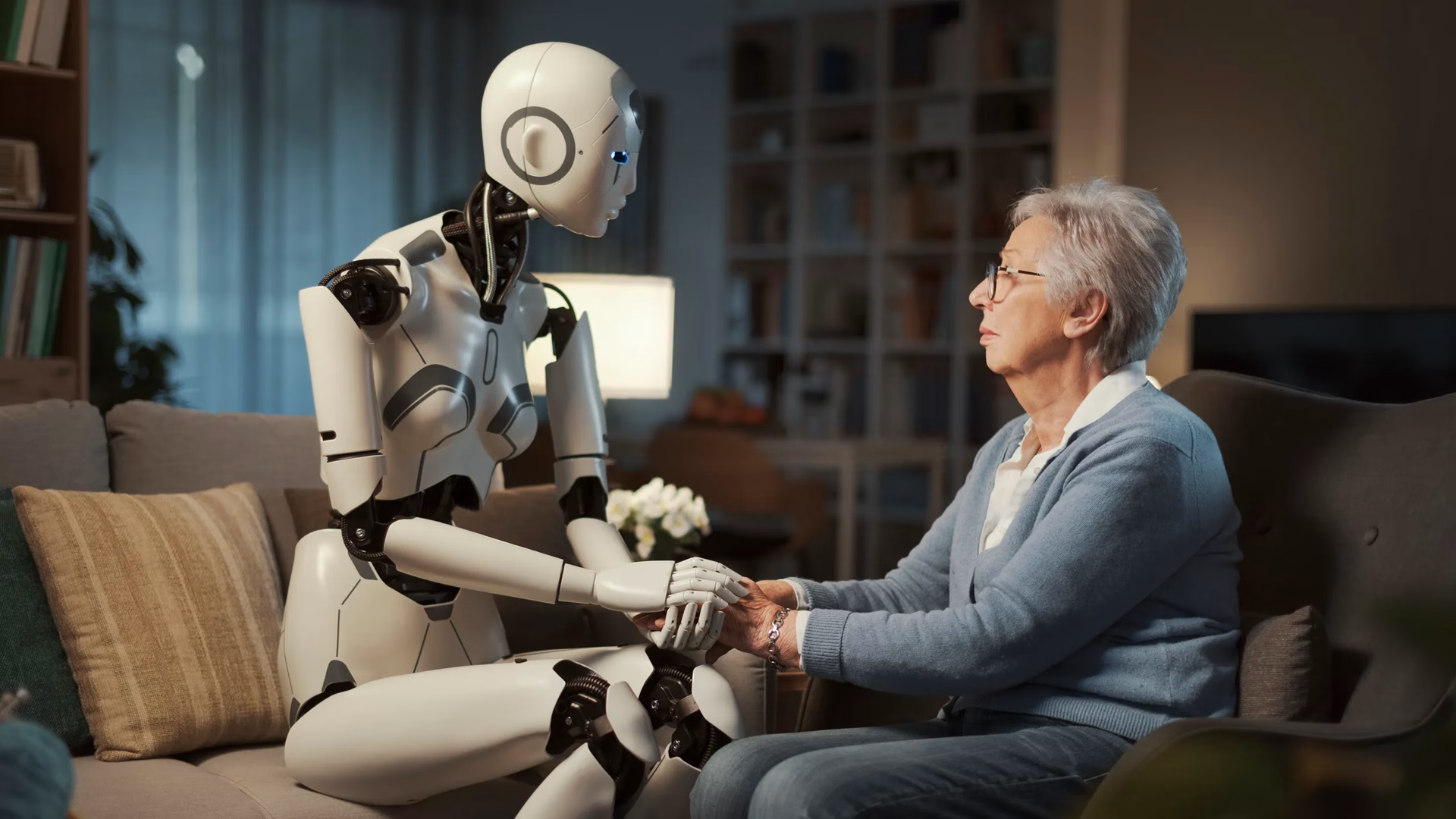

La relevancia de este avance trasciende los laboratorios. Imaginemos el impacto de un modelo de lenguaje asesorando sobre inversiones de jubilación o diagnosticando patologías clínicas.

En estos escenarios, el costo de una mentira “segura de sí misma” es incalculable. La implementación de métodos como el RLCR permite que, incluso si la IA comete un error, sea capaz de advertir al usuario sobre su falta de certeza, devolviendo el control al criterio humano.

Este ajuste matemático no solo mejora la precisión, sino que redefine nuestra relación con la tecnología. No buscamos oráculos infalibles, sino herramientas honestas que comprendan sus propias limitaciones. Al reducir la soberbia algorítmica, abrimos la puerta a una adopción masiva de la IA en la estructura misma de nuestra sociedad, garantizando que el progreso no se vea empañado por la desconfianza.

El camino hacia una transparencia algorítmica sin precedentes

Adoptar estos estándares de calibración supone un cambio de mentalidad en el desarrollo de software. Ya no basta con que una IA sea capaz de procesar billones de parámetros; ahora exigimos que sepa cuándo detenerse.

La capacidad de discernir entre el conocimiento sólido y la inferencia especulativa es lo que finalmente separará a las herramientas útiles de los simples generadores de texto.

Estamos ante el nacimiento de una nueva generación de sistemas que, por primera vez, priorizan la integridad sobre la mera apariencia de inteligencia, marcando un hito en la ética del aprendizaje automático.

Average Rating